Denne artikkelen ble opprinnelig publisert på morningstar.com den 11. oktober 2023.

Kunstig intelligens kan være et kraftig verktøy for investorer, med muligheten til hyppig tilegning av kunnskap om et emne, sile gjennom mengder av data, og tilby sammenligninger raskere enn de fleste mennesker. Hos Morningstar har vi utviklet vår egen løsning: Mo. Og mine kolleger har tidligere fremhevet halvlederindustrien som et modent område som AI-fokuserte investorer kan vurdere, samt har de også nylig diskutert hvordan AI kan hjelpe - og hindre - ESG-fokuserte investorer.

Hvordan ESG-risikovurderinger hjelper AI-investorer

Men AI er ikke et mirakelverktøy; det er farer fra miljø-, sosial- og styringsperspektiver. For å bedre forstå disse risikoene, kan vi benytte Sustainalytics sin ESG Risk Rating - og dens ledelseskomponent - for å finne ut hvilke AI-ledere i både halvleder- og programvareindustrien som er best posisjonert for å unngå fremtidige kontroverser.

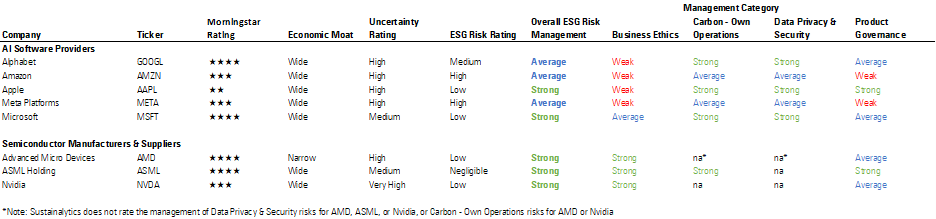

Håndteringen av flere vesentlige ESG-problemstillinger, eller MEI-er, kan spesielt fremheve hvilke selskaper som kan være best posisjonert for å lykkes med å navigere i en AI-basert fremtid. Disse vesentlige problemstillingene inkluderer forretningsetikk, karbon - egen drift, datasikkerhet og personvern, og produktstyring.

Da jeg også så nærmere på verdivurdering, fant jeg at Microsoft (MSFT), Advanced Micro Devices (AMD) og ASML Holding (ASML) stiger til toppen av listen over AI-muligheter, mens Amazon.com (AMZN) og Meta Platforms (META) tilbyr større ESG-risiko samt mindre attraktive nåværende aksjepriser.

Noen ledende AI-selskaper anses å ha bedre ESG-styring enn andre

Tabellen nedenfor fremhever AI-eksponerte selskapers verdsettelse, konkurranseposisjoner og ESG-risikostyring.

Kilde: Morningstar, Sustainalytics. Data as of Oct. 9, 2023

Vær oppmerksom på at dette er vurderinger, ikke nødvendigvis spådommer. Dessuten utgjør AI en veldig liten del av disse bedriftenes nåværende inntekter (og kanskje også deres fremtidige inntekter på kort sikt). Likevel er det viktig for AI-fokuserte investorer å forstå de viktigste ESG-risikoene som disse selskapene står ovenfor, gitt potensialet for økonomisk materiell skade på fremtidige kontantstrømmer dersom problemene ikke håndteres ordentlig.

ESG-risikoen ved AI, med dens egne ord

Når man kritiserer noen, virker det bare rettferdig å tilby de en sjanse til å forsvare seg. I dette tilfellet kunne jeg spørre AI direkte om sine ESG-risikoer. Til sin fordel, når den blir bedt om å gjøre det, gjør Bing Chat (som bruker Open AIs GPT-4 teknologi) en ganske god jobb med å skissere flere viktige ESG-risikoer ved AI og lenker til relevante artikler og forskning for å støtte.

Spørsmål: Hva er ESG-risikoene ved AI?

Svar (via Bing Chat): AI-relaterte ESG-risikoer (Environmental, Social, and Governance) er en økende bekymring. Her er noen av de viktigste risikoene:

1. Miljøpåvirkning: AI-systemer kan utgjøre en betydelig trussel mot bærekraftsmål på grunn av den store datakraften som trengs for å trene store nevrale nettverk. Karbonfotavtrykket fra lagring og behandling av data er enormt og voksende.

2. Sosiale risikoer: AI-systemer har blitt funnet å potensielt opprettholde rasemessig ulikhet og forstyrre demokratiske prosesser. Det er også bekymringer om hvorvidt individer behandles rettferdig av AI-systemer, eller om eksisterende samfunnsmessige ulikheter blir replikert eller til og med forsterket.

3. Styringsrisiko: Mangel på teknologiske ferdigheter i både toppledelsen og den generelle arbeidsstyrken kan gjøre bedrifter sårbare for feil. Problemer som algoritmisk skjevhet, forskyving av arbeid, ansvarlighet, personvern og pålitelighet er også betydelige bekymringer.

Investorer og virksomheter må være klar over disse risikoene når de implementerer AI-systemer og bør strebe etter ansvarlig AI-utvikling, anskaffelse og brukspraksis.

Fokus på styring av nøkkelrisikoer for AI-selskap

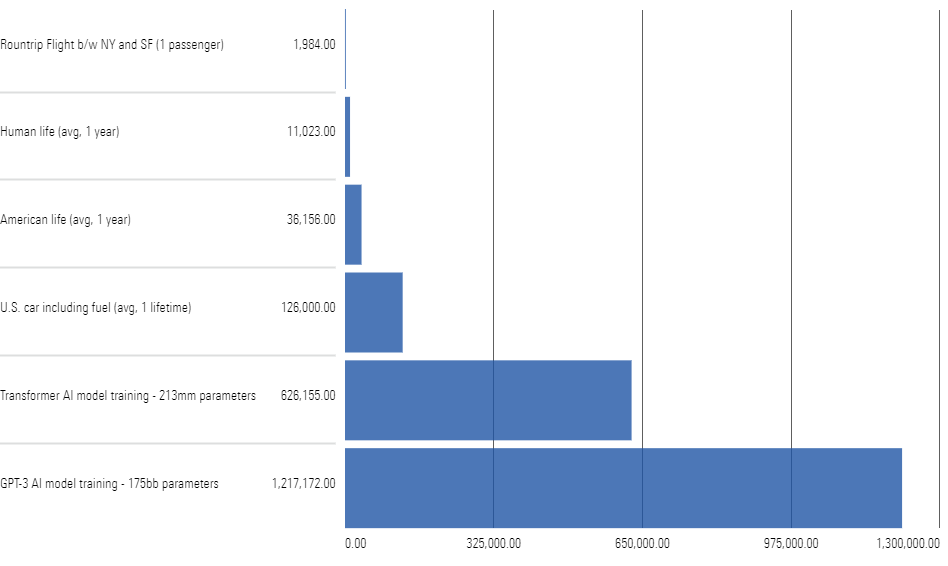

Miljømessige bekymringer knyttet til AI rangerer uten tvil høyest blant ESG-problemene som Bing tok opp - en 2019-studie fra MIT fant at trening av en stor AI-modell på den tiden kunne avgi nesten fem levetidsutslipp fra den gjennomsnittlige amerikanske bilen, for eksempel. Og dette tallet har økt siden den gang: En studie fra 2021 anslår at trening av OpenAIs GPT-3 var nesten dobbelt så karbonintensiv.

Trening av AI-modeller er svært karbonintensiv

Vanlige benchmarks for karbonfotavtrykk i pund av CO2-ekvivalenter.

Kilde: Strubell, Emma et al. "Energy and Policy Considerations for Deep Learning in NLP" (2019); Patterson, David et al. "Carbon emissions and large neural network training." (2021).

Men Bing Chat påpeker også sosiale og styringsmessige problemer, slik som iboende skjevheter, forskyving av arbeid og ansvarlig ledelse i et selskap.

Ledelseskomponenten i Sustainalytics sin ESG Risk Rating kan gi en viss innsikt. Sustainalytics tildeler selskaper Weak, Average eller Strong ledelsesscore for spesifikke MEI-er. De mest relevante MEI-ene når det gjelder AI, er de som dekker de overnevnte problemene forretningsetikk, karbon - egen drift og produktstyring.

Hvordan et selskap håndterer sitt karbonutslipp er en viktig vurdering i vår screening gitt energiintensiteten til AI-utviklingen. Hvordan det håndterer sin forretningsetikk tar i betraktning styringen av ledelsen og styret knyttet til spørsmål om immaterielle rettigheter, konkurransehemmende atferd og insentiver for å unngå uetiske muligheter. Og MEI for produktstyring fokuserer på flere nøkkelaspekter ved produktsikkerhet, inkludert spørsmål om dårlig håndtert innovasjon som kan føre til avvik fra kundenes forventning.

Sustainalytics' vurderinger er selvfølgelig ikke bare begrenset til kunstig intelligens. Men selskaper som følger beste praksis relatert til håndtering av disse materielle ESG-problemstillingene, er muligens best posisjonert til å håndtere relevante utfordringer etter hvert som AI-tilbudet fortsetter å vokse.

AI truer personvern

Det er en ytterligere risiko som bare nevnes kort av Bing: datasikkerhet og personvern. Ettersom forbrukere i økende grad bruker AI-verktøy som naturlig språkbehandling, er personvern og sikkerhet til personlig identifiserbare data av største betydning.

Tross alt kan det være akseptabelt at denne informasjonen brukes når en smart hjemmeenhet tilbyr en fristende annonse basert på en brukers søkehistorikk, men det er mer problematisk når Amazon lagrer barnestemmer eller Apple (APPL) bruker menneskelige transkriberinger for fremtidig algoritmeutvikling. Personvernsproblemer går også utover enkeltpersoner: Tidligere i år lekket Samsung-ingeniører ved et uhell sensitiv programmeringskode til ChatGPT da de brukte verktøyet for feilsjekking.

AI-leverandører har riktignok adressert mange av disse bekymringene de siste årene, inkludert at Apple ikke lenger ansetter kontraktører for å lytte til Siri-samtaler. Men verden beveger seg raskt. Det kan være fristende for selskaper uten riktige styringskontroller på plass å ignorere individuelle brukeres personvern i innovasjonens navn.

Disse risikoene har reelle implikasjoner i den virkelige verden. Som mine kollegaer bemerket i en artikkel i fjor, fortsetter kostnadene ved datainnbrudd å stige. Ifølge den siste IBM/Ponemon Institute-rapporten Cost of Data Breach 2023, steg denne kostnaden per brudd til 4,45 millioner dollar, opp 15,3% fra 2020. Og regulatorer vil sannsynligvis fortsette å se på dette området: Under det foreslåtte AI-lovforslaget fra EU, kan selskaper som bryter datahåndteringsbestemmelsene møte bøter på opptil 4% av inntektene.

Nå kan ansvarlig bruk av AI være gunstig; den samme IBM-studien viser at gjennomsnittskostnaden for et datainnbrudd for selskaper som bruker AI-sikkerhetsløsninger er nesten 20% lavere. Men som mange nye teknologier kan kunstig intelligens være et tveegget sverd. For langsiktige AI-investorer, vil det være avgjørende å ikke bare forstå mulighetene, men også de viktigste miljømessige, sosiale og styringsmessige risikoene.

Vennligst merk at denne artikkelen er helt eller delvis oversatt av en maskin, og det kan derfor være noen skrivefeil eller unøyaktigheter i teksten. Dersom du har spørsmål eller kommentarer til teksten, ta gjerne kontakt med guro.tungeland@morningstar.com